Educação

Estudo de Coimbra revela que conteúdos gerados por inteligência artificial contribuem para insegurança

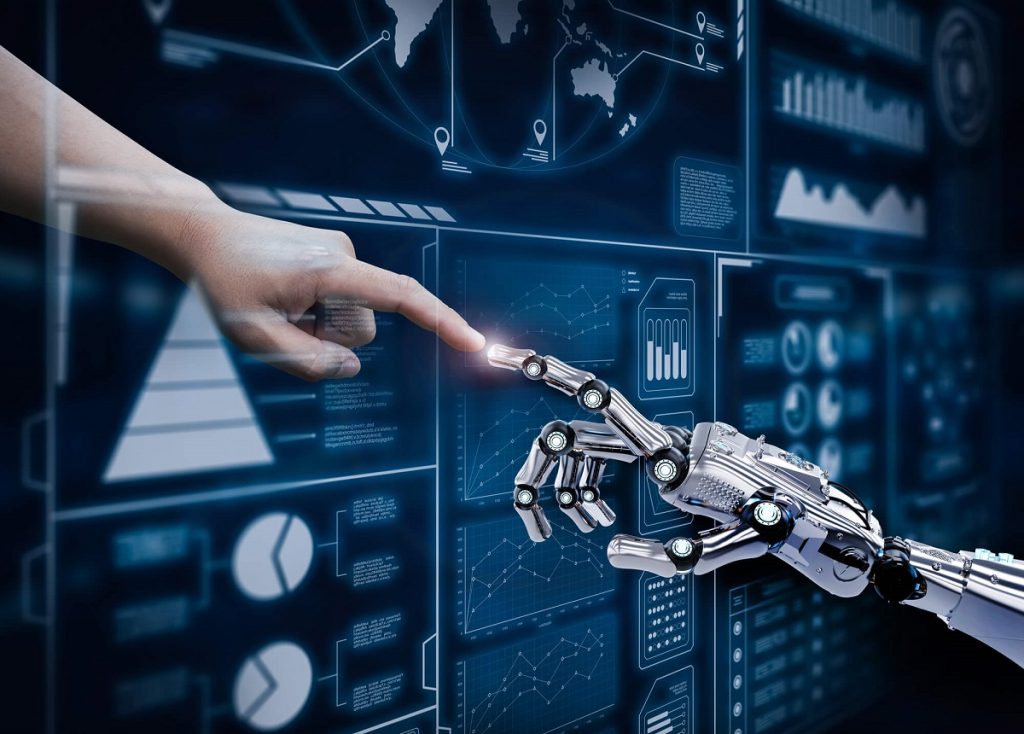

Conteúdos gerados por inteligência artificial (IA) contribuem para a construção de narrativas de insegurança e podem influenciar a perceção de risco das pessoas, com impactos no turismo, revelou um estudo internacional hoje divulgado pela Universidade de Coimbra (UC).

PUBLICIDADE

O trabalho foi desenvolvido por uma equipa composta por investigadores da UC, e das universidades de Shri Mata Vaishno Devi, Central de Jammu e Bundelkhand, todas na Índia, e de East London, no Reino Unido, que “explorou como imagens, vídeos e notícias produzidas ou amplificadas por sistemas de IA contribuem para a construção de narrativas de insegurança”.

PUBLICIDADE

Em nota enviada à agência Lusa, a Universidade de Coimbra adiantou ainda que os conteúdos gerados por IA sobre zonas de conflito “podem afastar turistas”, por aumentarem a ansiedade e a redução da intenção de viajar.

“Os investigadores alertam para a necessidade de um debate urgente sobre o papel da IA na formação da opinião pública e nas decisões individuais, particularmente em contextos de crise”, observou a UC.

A equipa internacional de investigadores centrou-se nos impactos destes conteúdos no turismo em algumas regiões do Líbano, “por conta do conflito em Gaza”, combinando a análise de conteúdo de quatro jornais ‘online’ internacionais, árabes e não árabes, com uma análise quantitativa das respostas aos questionários recolhidos junto de 503 cidadãos libaneses.

O estudo concluiu que a exposição aos produtos noticiosos desenvolvidos recorrendo à inteligência artificial “pode levar potenciais visitantes a sobrestimar os perigos associados ao destino, influenciando negativamente a decisão de viajar”, vincou, citada na nota, a docente da Faculdade de Letras (FLUC) Cláudia Seabra.

“O efeito é particularmente relevante em contextos de elevada incerteza, onde a informação circula rapidamente e nem sempre é devidamente verificada”, afirmou a também investigadora do Centro de Estudos de Geografia e Ordenamento do Território (CEGOT) da UC.

A investigação destacou ainda que “a IA não só reproduz conteúdos existentes, como também pode amplificar tendências sensacionalistas, contribuindo para uma perceção distorcida da realidade”, fazendo com que este fenómeno levante “questões importantes sobre a responsabilidade das plataformas digitais e a necessidade de mecanismos de regulação e literacia mediática”, adiantou Cláudia Seabra.

A pesquisa foi centrada no Líbano, território do Médio Oriente “cuja economia depende em parte do turismo e, como tal, os impactos podem ser significativos, e, por outro lado, um país muito próximo ao cenário de guerra”, contextualizou a investigadora da FLUC.

“A redução do fluxo turístico afeta diretamente negócios locais, emprego e o desenvolvimento regional, agravando os desafios económicos já existentes”, notou.

A investigação internacional evidenciou ainda a existência de diferenças relevantes entre conteúdos produzidos por IA e os desenvolvidos pelos meios de comunicação tradicionais.

“Enquanto o jornalismo profissional tende a seguir critérios editoriais, verificação de fontes e contextualização geográfica e política, os conteúdos gerados por IA, frequentemente disseminados em redes sociais, podem replicar padrões sensacionalistas, descontextualizar acontecimentos ou até criar cenários plausíveis, mas não verificados”, alertou Cláudia Seabra.

“Esta distinção torna-se crítica em contextos de conflito, onde a IA pode amplificar imagens e narrativas de violência de forma mais difusa e menos rigorosa, contribuindo para uma perceção de risco alargada a regiões não diretamente afetadas. Como resultado, os utilizadores expostos a este tipo de conteúdos tendem a formar perceções mais negativas e generalizadas, em contraste com uma leitura potencialmente mais equilibrada proporcionada pelos média tradicionais”, acrescentou.

PUBLICIDADE

PUBLICIDADE